Anthropic está en medio de un meollo importante con el Pentágono en Estados Unidos que puede acabar dando forma al futuro de la empresa. Fundada con la seguridad como razón de ser, acaba de reescribir las reglas que la definían. Y es que su “Política de Escalado Responsable”, el documento que establecía cuándo detener el desarrollo de un modelo demasiado peligroso, ha evolucionado a una mera hoja de ruta con objetivos flexibles. Y este cambio es bastante más importante de lo que parece. No solo para Anthropic, sino para el resto de la industria. Vamos al lío.

Qué ha cambiado exactamente. Hasta ahora, la política de Anthropic establecía que la compañía pausaría el entrenamiento o retrasaría el lanzamiento de un modelo si sus capacidades superaban la velocidad a la que podían desarrollarse salvaguardas suficientes. Es decir: si el modelo era demasiado potente para ser controlado con garantías, se frenaba.

Esto se acabó. Y es que la nueva política elimina ese mecanismo de freno automático y lo sustituye por una serie de compromisos públicos, junto con informes de riesgo periódicos auditados por terceros. El cambio lo confirmaba la propia empresa en un comunicado oficial.

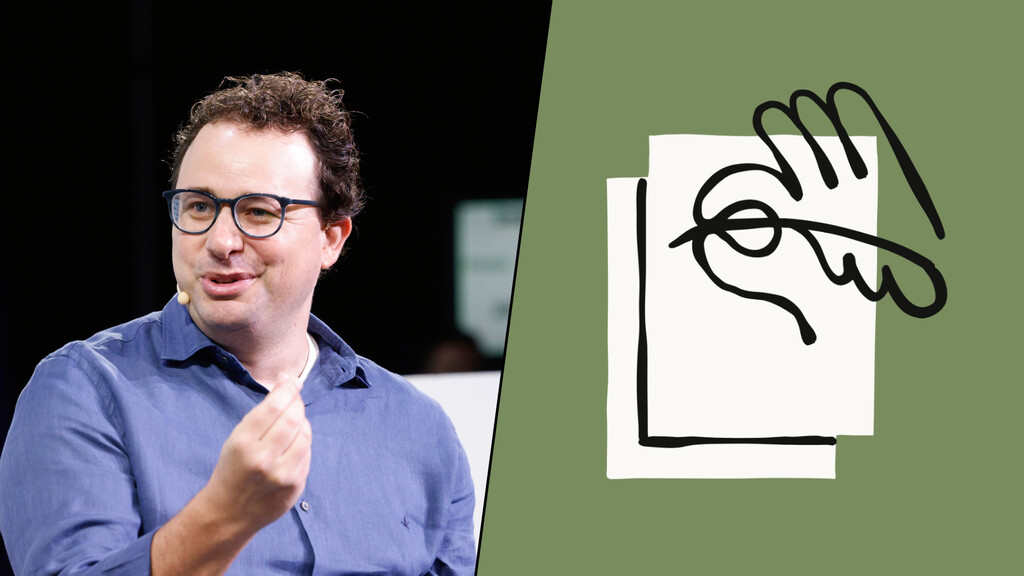

Por qué lo han hecho. La empresa da dos razones principales. La primera es el entorno competitivo: OpenAI, Google y xAI avanzan sin ese tipo de restricciones. "No sentíamos que tuviera sentido asumir compromisos unilaterales si los competidores están avanzando a toda velocidad", contaba Jared Kaplan, director científico de Anthropic, al Time. La segunda, como no podía ser de otra manera, es política: Washington le ha dado la espalda a la regulación de la IA, y Anthropic reconoce en su blog que el clima antiregulatorio actual hace que sus propias salvaguardas resulten asimétricas respecto al resto del sector.

Paradoja. Desde el punto de vista de Anthropic, no es una renuncia a la seguridad, sino una decisión tomada en base a ella. Su razonamiento: si los actores que son más responsables (ellos se meten en este saco, lógicamente) se detienen mientras los menos cuidadosos siguen adelante, el resultado neto es “un mundo menos seguro”.

La lógica tiene cierta coherencia, pero también supone aceptar que la seguridad pasa a depender de lo que haga la competencia. Y eso sí es un juego muy peligroso.

Contexto. Anthropic fue fundada por exdirectivos de OpenAI, entre ellos Dario Amodei, que abandonaron esa empresa precisamente por considerar que no prestaba suficiente atención a los riesgos de la IA. La nueva política llega en un momento en el que varios investigadores de seguridad han dejado la compañía. Tal y como compartía el Wall Street Journal, uno de ellos, Mrinank Sharma, escribió este mismo mes una carta a sus colegas diciendo que "el mundo está en peligro" a causa de la IA, antes de anunciar su marcha. De hecho, según fuentes cercanas al medio, su salida estaría relacionada en parte con esta decisión.

Qué pasa con el Pentágono. El anuncio llega en plena tensión con el Pentágono. El secretario de Defensa estadounidense, Pete Hegseth, dio a Anthropic un ultimátum el mismo martes en que se hizo público el cambio de política: modificar sus líneas rojas sobre el uso de Claude o arriesgarse a perder un contrato de 200 millones de dólares con el Departamento de Defensa. Desde Anthropic han dejado claro que ambos asuntos son independientes, pero la coincidencia temporal no ha pasado desapercibida.

Qué queda de la política de seguridad. No es un abandono total. Anthropic mantiene el compromiso de retrasar el desarrollo o despliegue de modelos "altamente capaces" en circunstancias específicas, y se compromete a publicar informes detallados de riesgo cada tres o seis meses, verificados externamente. La compañía también separa ahora sus propias directrices internas de sus recomendaciones para el resto del sector, reconociendo implícitamente que la apuesta por una "carrera hacia arriba", en la que otras empresas están adoptando, no ha funcionado como esperaban.

Imagen de portada | Wikimedia Commons y Anthropic

En Xataka | EEUU tiene un mensaje para las empresas de IA: en caso de necesidad, esa IA es del Estado

-

La noticia

Anthropic ha abandonado su principio más importante: ya no pausará modelos peligrosos si la competencia los saca antes

fue publicada originalmente en

Xataka

por

Antonio Vallejo

.

🔥 Ver noticia completa en Xataka.com 🔥